영상 링크: Can you prove AI ROI in Software Engineering? (120k Devs Study) – Yegor Denisov-Blanch, Stanford

채널명: AI Engineer

소프트웨어 엔지니어링에서 AI 도입의 ROI를 실제로 입증할 수 있는가? (12만 개발자 대규모 연구) 핵심 요약

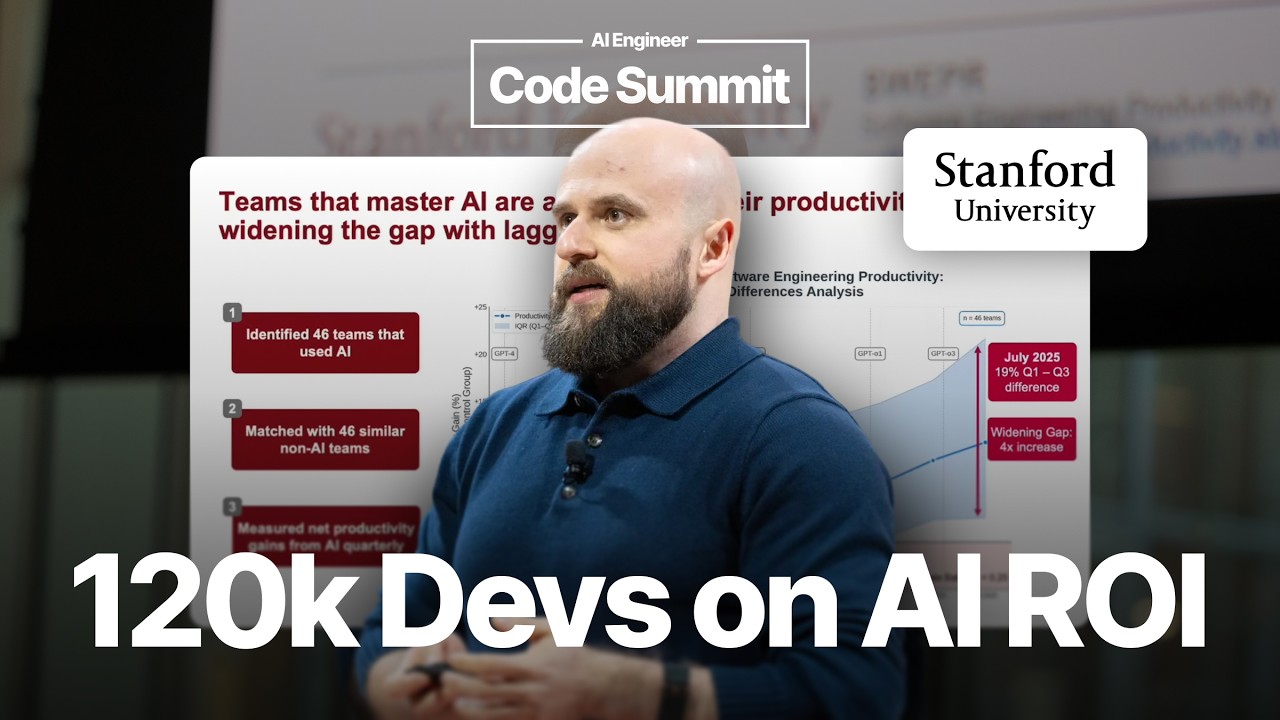

- 본 영상은 지난 2년 간 스탠포드 연구진이 약 12만 명 개발자 데이터를 분석해 소프트웨어 엔지니어링에서 AI 도입의 실제 생산성 및 ROI(Return On Investment) 효과를 체계적으로 검증한 결과를 공유함

- 연구는 Git 내역을 활용한 시계열/횡단적 분석과, 판넬 전문가의 코드 평가를 모방한 머신러닝 모델을 통해 AI가 실제로 생산성을 얼마나 높이는지 측정함

- 46개의 AI 활용팀과 비활용팀을 비교하였을 때, 2023년 7월 기준 AI 도입 팀의 생산성 중간값은 10% 상승(단, 상위/하위팀 간 격차가 점점 커지는 ‘부익부 빈익빈’ 현상 발생)

- AI 도구의 토큰 사용량(사용 강도)은 생산성과 느슨한 상관관계(0.20)만 보였고, 오히려 일정 사용량 구간에서는 생산성이 급감하는 ‘데스밸리’ 구간이 확인됨 → AI ‘사용량’보다 ‘사용 품질’이 더 중요

- 코드베이스의 ‘청결 지수’(테스트, 타입, 문서화, 모듈화 등)는 AI 생산성 향상과 0.4의 유의미한 상관관계를 보임 → 코드 관리가 AI 효과 극대화의 열쇠

- AI 활용의 실제 효과는 단순한 도구 액세스나 사용량이 아닌, 조직 내 AI적 활용 패턴과 엔지니어링 환경에 따라 크게 달라짐

- AI 도입 효과 정량화에는 ‘AI 활용률’뿐 아니라, 전문가 패널 기준을 모사한 신규 엔지니어링 산출 추정 지표와 이를 위한 가드레일(재작업률·품질 등) 지표의 복합적 활용이 필요함

- 실제 사례 연구에서 AI 도입 후 PR 수(14% 증가)는 늘었으나, 코드 품질은 9% 하락, 재작업률 2.5배 증가, 실질 산출물은 의미 있게 증가하지 않아 ‘표면적 수치’만으로 AI ROI를 판단하면 위험함

- 결론적으로, 기업의 AI 도입 효과를 현실적으로 측정하고 개선하려면 질적으로 다각적이고 심층적인 데이터 분석 및 관리가 필요하다고 강조함

세부 요약 - 주제별 정리

AI의 소프트웨어 엔지니어링 생산성 증대는 장기적 데이터 분석과 전문가 판넬 기준으로 측정함

- 기업들은 소프트웨어 엔지니어링에 AI 도구 도입에 수백만 달러를 투자하지만, 실제 효과는 불명확함

- 스탠포드 연구팀은 지난 2년간 대규모(약 12만 명) 데이터 기반으로 AI 도입 전후의 생산성 변화를 장기적으로 추적

- 코딩 커밋을 여러 전문가(10~15명)의 유지보수성, 구현 속도, 복잡도 등 기준으로 평가한 결과를 ML 모델에 학습시켜, ‘전문가 패널’ 평점을 자동화함

- 이 방식으로 대규모 기업 내 다양한 팀들의 생산성 관련 데이터를 효율적으로 정량화/비교 가능하게 함

- 패널 점수 기반 모델의 신뢰도에 의구심이 들 경우, 실제 전문가 집단으로 교차 검증 진행 가능

- 연구 전반의 분석 구조: AI 도입 생산성 드라이버 조사 → AI 활용 패턴 벤치마크 개발 → AI ROI 측정법 제안 → 실제 조직 적용 사례 분석 순

AI 도입팀과 비도입팀의 생산성 차이는 평균 10% 상승이지만, 상위와 하위 간 격차가 확대되고 있음

- AI를 도입한 46개 팀, 도입하지 않은 46개 팀을 매칭하여 분기별 생산성 변화를 측정

- 2023년 7월 기준 AI 도입팀의 생산성 중위값(median)은 약 10% 증가함

- 데이터 범위의 안쪽 50%를 제외한 극단값에서는 일부 팀이 월등히 높은 혹은 낮은 효과를 보임

- 상위권 팀과 하위권 팀 간 성과 격차(variance)가 점점 커지고 있어 ‘AI 선도조’의 성장 효과가 더욱 가속화되는 모습(“부익부 빈익빈” 현상)

- 이러한 격차가 계속 커질 경우, 초기 AI 성공 도입팀이 복리화된 경쟁 우위 확보 가능성이 높음

- 기업 리더는 자사 팀이 어느 위치(cohort)에 있는지 정확히 파악하고, 영향 측정/개선을 도모해야 함

AI 도구의 ‘사용량’이 아닌 ‘사용 품질’이 생산성 향상에 결정적임

- 팀별 엔지니어 1인당 월별 토큰 소비량(AI 사용량)과 생산성 간 상관관계는 매우 낮음(선형 상관계수 약 0.20)

- 오히려 토큰 사용량이 약 1000만 단위에서 생산성이 가장 낮아지는 ‘데스밸리(death valley) 현상’ 관찰됨

- 일부 팀은 토큰을 과도하게 사용할수록 효율이 오히려 저하되는 경향을 보여줌

- 따라서 무작정 AI 도구를 많이 쓰는 것보다, ‘언제/어떻게’를 명확히 구분해 활용하는 품질이 성과에 더 중요하다는 결론

코드베이스의 청결도가 AI 생산성 향상을 결정짓는 주요 요인이 됨

- ‘엔지니어링 환경 청결성 지수(Environment Cleanliness Index)’를 새롭게 개발

- 이 지수는 테스트 커버리지, 타입/정적 분석, 문서화, 모듈화, 코드 품질 등 다양한 요소를 합산한 0~1 점수로 구성

- 해당 청결 지수와 AI 활용에 따른 생산성 증분 간에는 R제곱 0.4의 유의미한 상관관계가 존재(상태가 좋을수록 생산성 향상)

- 즉, 코드베이스가 깔끔하고 관리 수준이 높을수록 AI 활용 시 얻는 이익이 증폭됨

- 반대로 코드 품질이 나쁘면, AI 활용은 기술부채/엔트로피 증가로 이어질 수 있음

코드베이스 관리가 AI 효과 극대화의 핵심이고, 코드 품질 악화 방지에 주의를 기울여야 함

- 모든 시점의 코드베이스는 “청결함-비청결함”이라는 축 위에서 위치함

- 청결한 코드베이스일수록 AI가 수행할 수 있는 자동화 비중이 높아지고, 사람의 개입이 줄어듦(도식적 색상 그래프 설명)

- 엔지니어는 AI 활용으로 인한 코드 엔트로피 증가를 의식적으로 관리(기술 부채 해소 등)해야 하고, 그렇지 않으면 생산성 이득이 상쇄됨

- 엔지니어가 AI 활용 범위·시점을 명확히 숙지해야 하며, 무분별하게 적용 시 AI 산출물을 거부하거나 대량 수정하게 되어 신뢰가 붕괴하는 악순환 발생

조직 내 AI 활용 실태는 단순한 도구 접근성이나 사용량으로는 정확히 파악할 수 없음

- AI ‘공식 지원’ 여부보다 실제 “어떻게” AI를 사용하는지가 더 큰 변수를 만듦

- AI 엔지니어링 활용도의 레벨을 0~4까지 구분(0=AI 미활용, 1=개인적 사용, 2=팀 단위 활용, 3=AI가 일부 작업 자율수행, 4=AI가 전체 프로세스 오케스트레이션)

- 실제로는 동일한 회사 내에서도 부서(예: 두 비즈니스 유닛)마다 AI 활용률이 40% 대 10% 미만 등으로 큰 차이를 보임

- 이는 단순히 라이선스, 도구, 접근권한만 부여한다고 조직 전체가 동일한 효율을 얻지 못함을 의미

- 따라서 경영진은 AI 사용 유무만 볼 것이 아니라 실제 현장에서의 구체적인 ‘활용 방식’에 집중해야 함

- 해당 벤치마크 도구는 sweeper research portal에서 오픈소스 형태로 공개 예정

AI ROI 측정 시, 단순한 비즈니스 결과 대신 ‘엔지니어링 산출’ 위주로 평가해야 함

- ‘AI 도구 도입 → 매출 증가’ 등 비즈니스 관점에서 직접 ROI 측정이 가장 이상적이나, 실제로는 변수와 노이즈가 많아 인과관계 파악이 어렵다는 한계 존재

- 세일즈·PM·외부환경 등 수많은 혼재계 변수로 인해, 엔지니어링 단계의 성과 지표로 대체(프록시)하는 것이 합리적

- 엔지니어링 산출 변화 시, 실제로 비즈니스 효과로 환원 가능한 구조/product-market fit 등 추가 전제조건 붙음

- AI 효과 측정을 위한 메트릭은 “AI 사용량(usage)”과 “엔지니어링 산출물(outcome)”의 두 축으로 구성

AI 사용량(Usage)은 액세스 기반보다는 텔레메트리/실제 사용기록 기반이 신뢰성 높음

- 액세스 기반: AI 도구 사용권 부여 전후의 그룹 간, 또는 도입 전후 같은 그룹의 생산성 비교하는 방식(노이즈 많음)

- 사용기반: API/도구에서 실시간으로 수집되는 텔레메트리에 근거해 실제 누가, 어떻게 쓰고 있는지 정밀 분석

- 최근 도구(GitHub Copilot 등)는 데이터 집계 수위, 세분화 정도가 다르지만, git 기록을 활용해 과거 시점까지 회고형 분석 가능

- 이미 AI를 도입한 팀도 과거 데이터로 효과 측정 시뮬레이션 가능

‘산출/품질’의 신뢰성 있는 측정을 위해 주 메트릭과 가드레일 메트릭의 복합 활용이 필요함

- 주 메트릭: 머신러닝 기반 전문가 패널 점수(LoC, PR 수, DORA metric은 부적합)

- 가드레일 메트릭: 재작업·리팩토링 비율, 품질(기술적 위험 등), 사람/데브옵스 항목 등

- 가드레일 메트릭은 지나친 최적화 지양, 적정 건강 수준 유지가 목표

- 생산성 지표만을 맹목적으로 추적하면 Goodhart’s Law(측정이 목표가 되어 왜곡되는 현상) 발생 위험 있으므로, 다양한 지표 조화/조작 방지노력이 병행되어야 함

실제 대기업 사례에서는 PR 수 증가만으로 생산성과 ROI 효과를 오판할 수 있음

- 한 대기업(350명 규모 팀)이 2023년 5월 AI 도입, 전후 각 4개월간 변화 분석

- 도입 후 PR 수 14% 상승(표면상 생산성 증가), 하지만 코드 품질 9% 하락, 품질 변화 편차도(일관성 저하) 커짐

- 머신러닝 기반 산출(Effective Output)은 의미 있는 증가 없이 정체

- 재작업(Rework) 비율 2.5배 급증(부정적 신호)

- 즉, AI 도구 도입이 수치상 PR·커밋량만 늘리고 실질적 산출이나 코드 품질, 유지보수성 등은 오히려 악화될 위험 존재

- 기업이 PR 수 등 겉보기 수치만으로 ROI를 산정하면 “생산성 14% 상승 = 수백만 달러 이익”으로 오판할 수 있는 사례

AI 도입 자체는 중단할 문제가 아니라, 데이터를 바탕으로 실질적 개선점을 찾아야 함

- AI 도입 효과와 위험도를 정량적으로 분석하면, 문제점 파악 및 개선에 활용, 도입 중단보다는 ‘운용 방식 최적화’가 본질

- AI는 장기적으로 조직 경쟁력에서 빠질 수 없는 기술이기 때문에, 도입 후 데이터 기반 피드백 루프 구축이 필수

- 해당 연구는 소프트웨어 엔지니어링 내 AI 활용의 구체적·정량적 효과 측정 도구와 프레임워크를 제시함

연구 참여 및 추가 리서치 데이터를 확보하기 위해 기업 대상 참여를 독려함

- 영상에서 소개된 주요 툴, 데이터 대시는 sweeper research portal(Stanford)에서 접근 가능

- AI 도구(Copilot, Cursor 등) 도입 기업의 연구 참여 독려, 공저 논문 등 학계 환류 목적

- “software engineering productivity.stanford.edu”에서 연구 참여 신청 가능